Tech News Daily

Tech News Daily 23/07/2025 21:18:43

Meta xóa 635.000 tài khoản Facebook và Instagram đe dọa an toàn trẻ em

Theo báo cáo mới nhất từ Meta, tập đoàn đã xóa hơn 135.000 tài khoản Instagram vì để lại bình luận mang tính tình dục hoặc yêu cầu hình ảnh nhạy cảm từ các tài khoản do người lớn quản lý có trẻ em dưới 13 tuổi.

Bên cạnh đó, 500.000 tài khoản liên kết khác trên Facebook và Instagram cũng bị gỡ bỏ nhằm ngăn chặn triệt để hành vi vi phạm. Những người dùng từng bị các tài khoản này nhắm tới cũng đã nhận được thông báo từ nền tảng.

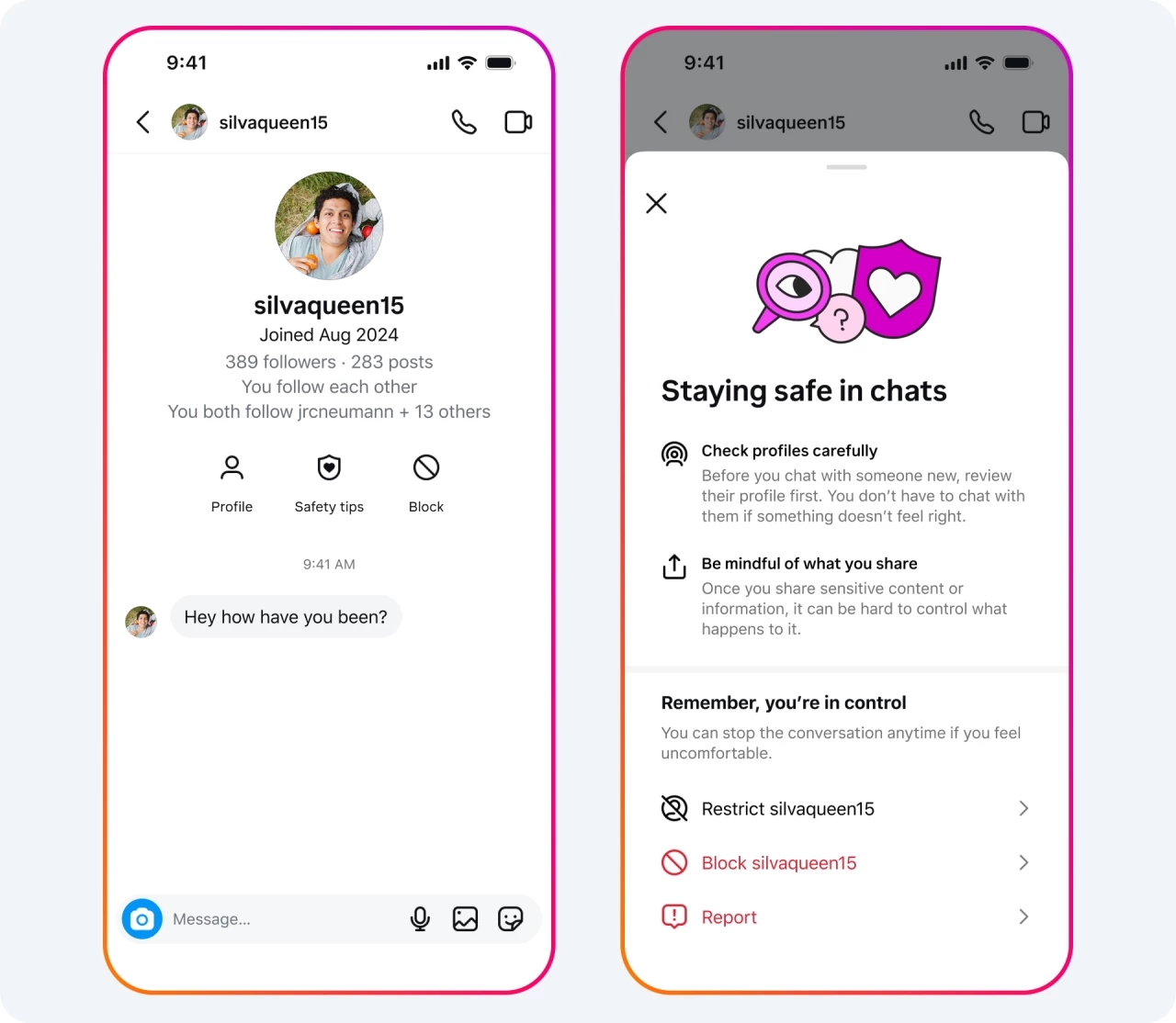

Meta chia sẻ rằng các biện pháp bảo vệ ảnh khỏa thân trong tin nhắn trực tiếp (DM) được giới thiệu từ năm ngoái đã mang lại hiệu quả đáng kể. 99% người dùng, bao gồm cả thanh thiếu niên, vẫn giữ nguyên tính năng làm mờ ảnh nhạy cảm, tính năng này được bật mặc định cho người dùng dưới 18 tuổi.

Thống kê cho thấy hơn 40% ảnh nhạy cảm nhận qua DM vẫn bị làm mờ trong tháng 6, và 45% người dùng chọn không mở hoặc chia sẻ ảnh sau khi được cảnh báo trong tháng 5.

Một loạt tính năng mới cũng được áp dụng cho các tài khoản trẻ em và người lớn đại diện cho trẻ (như cha mẹ hoặc quản lý nghệ sĩ nhí). Theo đó, các tài khoản này sẽ tự động bị giới hạn tin nhắn, bật tính năng "Từ ngữ ẩn" để lọc bình luận độc hại, đồng thời không được gợi ý với các tài khoản người lớn có dấu hiệu khả nghi.

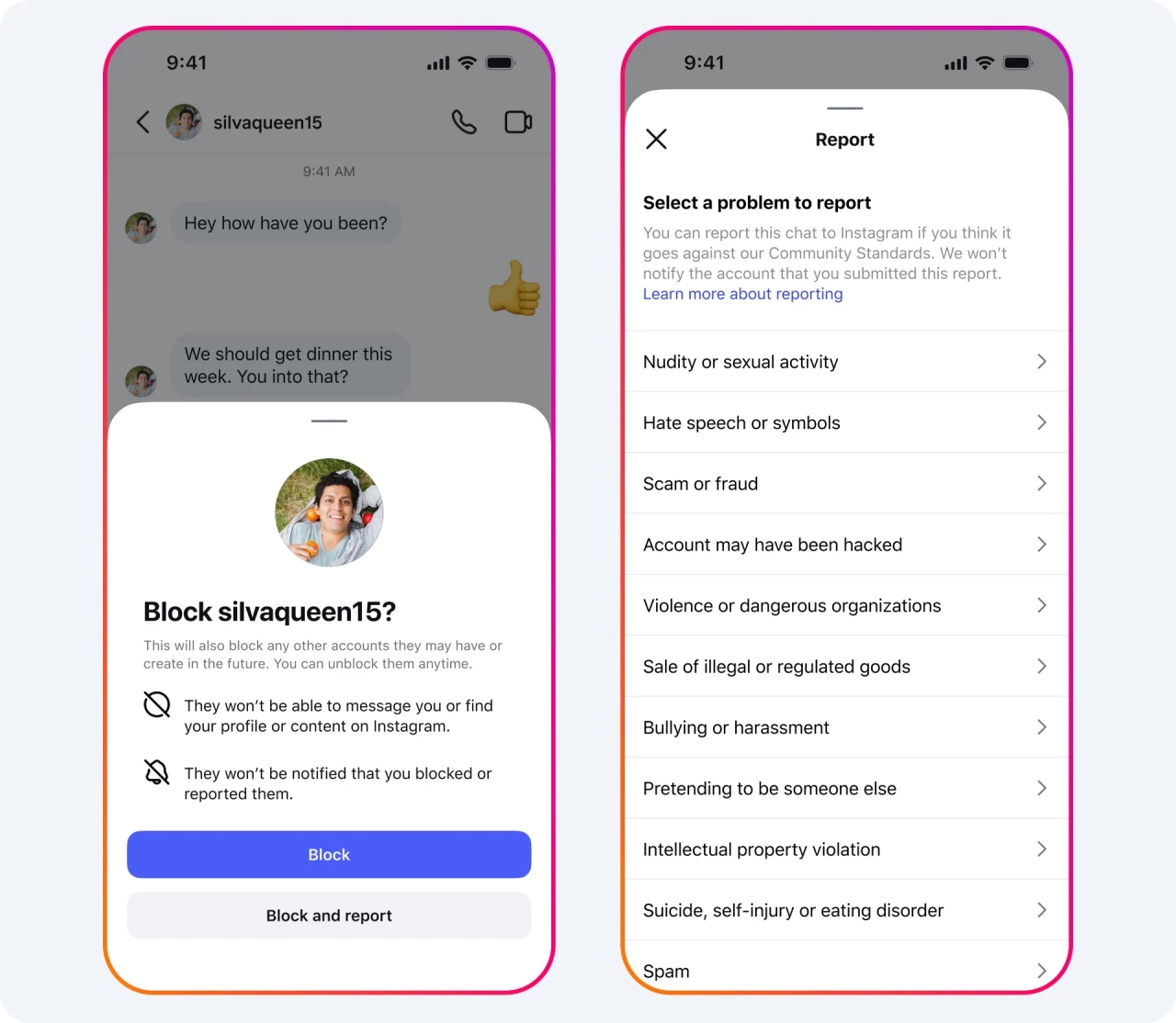

Với người dùng thanh thiếu niên, Instagram sẽ hiển thị rõ thời gian tạo tài khoản của người gửi tin nhắn trong cuộc trò chuyện mới. Ngoài ra, nút “Chặn và báo cáo” được kết hợp thành một thao tác duy nhất giúp quá trình xử lý vi phạm trở nên đơn giản và hiệu quả hơn.

Meta cũng sử dụng trí tuệ nhân tạo (AI) để phát hiện và chuyển các tài khoản nghi ngờ là trẻ vị thành niên vào chế độ hạn chế phù hợp với lứa tuổi. Các biện pháp này cho thấy cam kết của công ty trong việc bảo vệ người dùng trẻ tuổi, giữa bối cảnh ngày càng nhiều tranh cãi xoay quanh mức độ an toàn của thanh thiếu niên khi tham gia mạng xã hội.